L’augment de l’ús de la intel·ligència artificial (IA) està canviant com treballem en el dia a dia. Si a tu encara no t’ha canviat la manera de treballar, o t’estàs quedant fora, o et canviarà en els propers mesos. Però aquest canvi també afecta en com prenem decisions a la feina: des de la selecció de personal fins a l’assignació de recursos. I com que les males notícies no venen mai soles, i malgrat el potencial benefici transformador, la IA també està reproduint i amplificant els biaixos presents en les dades i en els equips que la desenvolupen. Són biaixos culturals, de gènere, territorials, econòmics… I és per això que les dones, i els col·lectius vulnerables ens hem de posar les piles per jugar un paper fonamental i canviar les regles del joc que s’estan establint ara mateix.

Ho deia en Ganyet fa unes setmanes: Internet s’ha convertit en 5 webs: Facebook, Instagram, Google, Amazon i Twitter. Totes controlades per 5 senyors molt senyors i molt poderosos. Aquests sistemes estableixen la informació que ens arriba al nostre ordinador, telèfon, i tauleta. És per això que Elon Musk vol eliminar la Viquipèdia, perquè no està en venda i en tenir un sistema jeràrquic i social tan fort és difícilment manipulable.

Els sistemes d’IA són les eines del futur on rebrem com pervivim el món, i per això ara mateix hi ha una cursa de “cremar diners” per fer-se amb el trosset de pastís més gros del mercat. Aquestes eines basen la seva intel·ligència en grans quantitats de dades històriques (algunes propietàries, altres lliures i obertes) per entrenar models que prenguin decisions i ens les mostrin. Aquestes dades no són “neutres”, són les que actualment tenen els senyors que controlen els mitjans i el contingut a Internet, i reflecteixen les desigualtats del present i del passat.

"S’ha demostrat que els algoritmes de selecció de personal poden penalitzar els salaris de les dones perquè les dades històriques mostren que elles han tingut un 30% menys de salari per una mateixa posició"

Per exemple, s’ha demostrat que els algoritmes de selecció de personal poden penalitzar els salaris de les dones perquè les dades històriques mostren que elles han tingut un 30% menys de salari per una mateixa posició. Per tant, aquesta desigualtat, s’ha d’identificar, i corregir manualment.

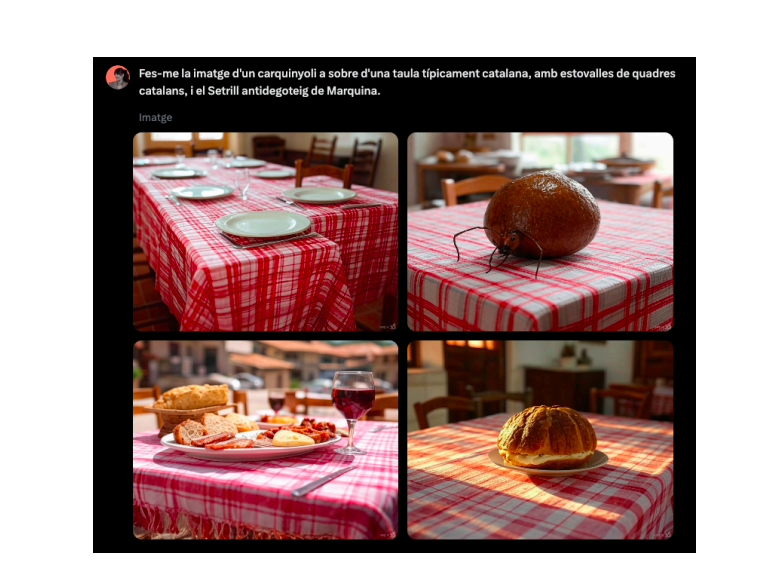

Un altre exemple seria quan demanem a una IA generativa que ens faci una imatge d’un carquinyoli. Com que s’han entrenat amb dades americanes o xineses, i allà el tema carquinyoli el porten regular, acostumen a pintar una espècie de coca, o un dònut. Per ells és el que més s’assembla a un carquinyoli. Podeu fer la prova.

Els biaixos no són merament accidents tècnics, sinó el resultat d’una manca de diversitat històrica en els equips que manen, dissenyen, i implementen aquestes tecnologies. Quan el 78% dels professionals de la IA són homes, segons les últimes dades, les perspectives i experiències femenines queden infrarepresentades, però també en diversitat d’origens, vivències, o capacitats.

"Els biaixos no són merament accidents tècnics, sinó el resultat d’una manca de diversitat històrica en els equips que manen, dissenyen, i implementen aquestes tecnologies"

Però què passa quan dones lideren equips tecnològics? S’han observat avanços significatius en la identificació i correcció de biaixos. Per exemple, la investigadora i activista digital ghanesa-americana Joy Buolamwini va demostrar com els sistemes de reconeixement facial tenien una taxa d’error molt més elevada per a dones negres que per a homes blancs. La seva feina va provocar que empreses com IBM i Microsoft revisessin els seus algoritmes. Ningú s’hi havia fixat abans? Potser si, però no els hi interessava corregir-ho. O potser no, i això denota que ningú s’hi havia trobat en aquell entorn.

Les dones líders en IA també estan impulsant una tecnologia que prioritza l’impacte social positiu. Programes dissenyats per detectar violència domèstica, algoritmes que milloren l’accés a l’educació per a nenes en països en desenvolupament, o tenen la mirada en els seus fills amb capacitats diverses. Són sovint el segell de dones en posicions de lideratge: que miren les cures, i les seves problemàtiques diàries.

Malgrat aquests avenços, les dones encara afronten nombrosos obstacles per accedir a posicions de poder en el camp de la tecnologia. Aquests inclouen la manca de mentors i mentores, biaixos implícits durant els processos de selecció, la difícil i maleïda conciliació, i una cultura corporativa que sovint desincentiva la diversitat. A més, les veus crítiques femenines són, de vegades, silenciades o ignorades, com va succeir amb la sortida polèmica de Timnit Gebru de Google, una de les expertes més destacades en ètica de la IA, que va ser víctima dels seus descobriments sobre els biaixos a l’empresa.

"Les dones líders en IA també estan impulsant una tecnologia que prioritza l’impacte social positiu"

El futur de la IA no està escrit, i tenir perfils diversos és imprescindible per identificar els biaixos. Necessitem eines que no només siguin precises, sinó també justes i representatives. Això requerirà esforços coordinats: programes educatius que incentivin a tenir una bona mirada digital crítica a totes les edats, polítiques corporatives que promoguin la diversitat i, sobretot, el reconeixement del valor que aporten les dones, i els perfils diversos, a un camp clau per al nostre futur col·lectiu.

Potser encara no sabem quines formes prendran les tecnologies que vindran, però podem imaginar un horitzó on els algoritmes siguin teixits amb justícia i empatia, reflectint la diversitat dels somnis humans. Al cap i a la fi, construir una IA inclusiva és més que un repte tècnic: és una declaració de qui volem ser com a societat. Un altre debat és si els genets de l’apocalipsi que preguen allò de què “el mercat es regularitza sol”, vulguin que tinguem una societat més empàtica i justa. Venen temps foscos.