Las grandes corporaciones tecnológicas compran compañías más pequeñas continuamente. De hecho, lo hacen a tal velocidad que la gran mayoría de los golpes ni siquiera es noticia. El caso es que a principios del 2014, Google adquirió una compañía europea –con sede en Londres–, por casi 500 millones de euros que, si bien la noticia no inundó los medios de todo el mundo como el caso de la compra de Whatsapp por parte de Facebook, podría ser infinitamente más importante en un futuro.

La compañía en cuestión se decía DeepMind Technologies y estaba fundada por Demis Hassabis un prodigio del ajedrez cuando era sólo un niño y actualmente un neuro-científico de renombre. Y que producía DeepMind para resultar interesante al gigante de los buscadores? Pues sorprendentemente, y según explicaban a su sitio web, DeepMind producía tecnologías para el comercio electrónico y los juegos en linea. La realidad es que sus productos iban bastante más allá. La estrella de DeepMind era un sistema de inteligencia artificial inigualable, capaz de aprender de sus propios errores sin ningún tipo de intervención humana.

A la práctica esto quería decir que DeepMind podía poner su sistema a jugar a un vídeo-juego y que cuando perdía, él a solas era capaz de analizar el porque de su derrota, para asegurarse que no se repitiera. Explicado así puede parecer una futilesa, pero el que Googlevio tenía muy potencial: un sistema de inteligencia artificial –no necesariamente aplicado a los videojuegos– capaz de aprender por sí solo.

El control ético

En el momento de la compra, Google compitió con otras grandes empresas del sector –entre las cuales Facebook–, y uno de los hechos que hizo inclinar la balanza hacia su lado fue la prometida de establecer un comité para la ética de la inteligencia artificial integrado por ingenieros de Google, de DeepMind e investigadores del Instituto para el Futuro de la Humanidad –sí, el nombre no es broma–, de la Universidad de Oxford.

Pues bien, parece que DeepMind evolucionado tan favorablemente –de hecho ya ha conseguido ganar en varias ocasiones al campeón mundial de Go, un juego de estrategia de tablero–, que Google ha empezado a preparar un protocolo de seguridad para evitar que la inteligencia artificial "se pase de lista".

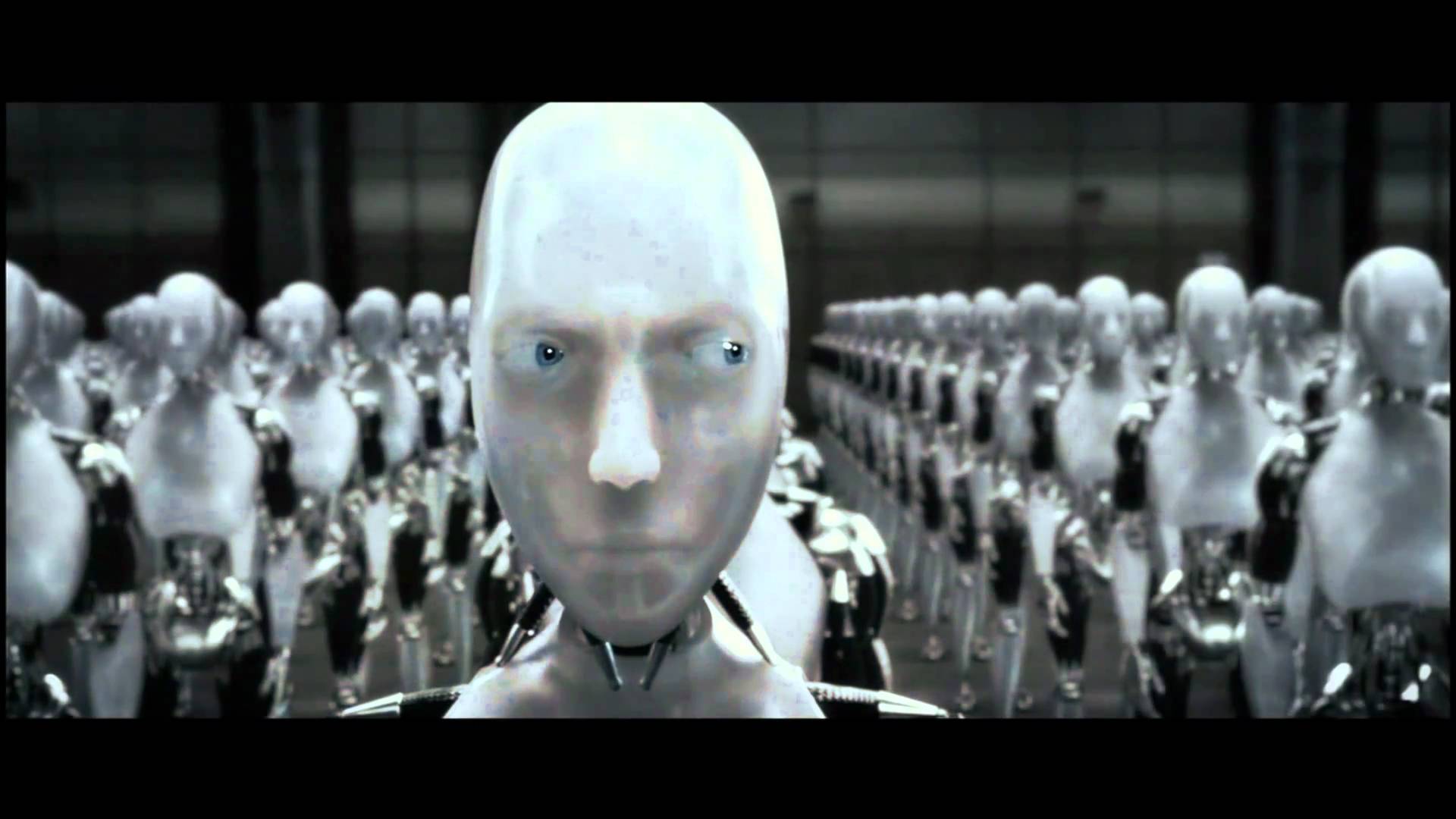

De hecho, Nick Bostrom, uno de los integrantes del Instituto para el Futuro de la Humanidad opina que, a pesar de que los actuales sistemas de inteligencia artificial todavía tardarán fuerza a igualar la capacidad humana, un golpe lo hagan no los costará mucho superarla hasta adquirir el que él denomina estado de súper-inteligencia. Y a pesar de que esta súper-inteligencia puede resultar muy poderosa por el adelanto de la raza humana, también puede ser peligrosa.

Los humanos entran en escena

Así pues, los ingenieros de Google ya trabajan en un procedimiento que permita a un operador humano interrumpir cualquier proceso de inteligencia artificial sin que este aprenda a protegerse de futuras interrupciones.

El gran reto al cual se enfrentan estos investigadores es más ético que técnico, y por este motivo sus equipos están integrados también por filósofos o psicólogos–. Imagináis el caso de un coche autónomo que funciona gracias a un sistema de inteligencia artificial. Si el vehículo detecta que hay un grupo de personas cruzando fuera de un paso de peatones, y que el coche va demasiado deprisa para evitar la colisión sin que los ocupantes del vehículo sufran daños, que se supone que tendría que hacer?

Veremos con qué respuesta nos sorprende Google, que ya ha aglutinado bajo las órdenes de Andy Rubin –el padre del sistema operativo Android– todos los esfuerzos y empresas del conglomerado Alphabet dedicadas a la robótica y la inteligencia artificial.